简介

本章节详细介绍AMCT量化场景,以及每个场景下的功能。

量化方式

AMCT支持命令行方式和Python API接口方式量化原始网络模型,两种方式优缺点比较如下:

命令行方式 |

Python API接口方式 |

|---|---|

量化准备动作简单,只需准备模型和模型匹配的数据集即可。 |

需要了解Python语法和量化流程。 |

量化过程简单,只涉及参数选择,无需对量化脚本进行适配。 |

需要适配修改量化脚本。 |

当前仅支持如下特性:

|

支持量化的所有功能。 |

命令行方式中的均匀量化示例请参见快速入门,QAT模型适配CANN模型命令行方式调用示例请参见Gitee或Github;Python API接口方式请参见手工量化。

量化分类

量化根据是否需要重训练,分为训练后量化(Post-Training Quantization,简称PTQ)和量化感知训练(Quantization-Aware Training,简称QAT)。当前版本仅支持训练后量化。

训练后量化:是指在模型训练结束之后进行的量化,对训练后模型中的权重由浮点数(当前支持FP32/FP16)量化到低比特整数(当前支持INT8/INT16),并通过少量校准数据基于推理过程对数据(activation)进行校准量化,从而尽可能减少量化过程中的精度损失。训练后量化简单易用,只需少量校准数据,适用于追求高易用性和缺乏训练资源的场景。

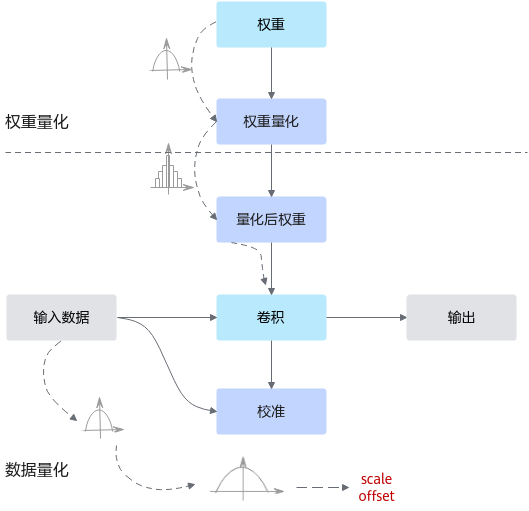

通常,训练后的模型权重已经确定,因此可以根据权重的数值离线计算得到权重的量化参数。而通常数据是在线输入的,因此无法准确获取数据的数值范围,通常需要一个较小的有代表性的数据集来模拟在线数据的分布,利用该数据集执行前向推理,得到对应的中间浮点结果,并根据这些浮点结果离线计算出数据的量化参数。其原理如图1所示。训练后量化使用的量化算法请参见训练后量化算法。

根据量化后是否手动调优量化配置文件,分为手工量化和自动量化。

根据是否对权重数据进行压缩又分为均匀量化和非均匀量化。如果量化后的精度不满足要求,则可以进行自动量化或手工调优,推荐使用自动量化。

相关概念

术语 |

解释 |

|---|---|

数据量化和权重量化 |

训练后量化根据量化对象不同,又分为数据(activation)量化和权重(weight)量化。 当前昇腾AI处理器支持数据(activation)做对称/非对称量化,权重(weights)仅支持做对称量化(量化根据量化后数据中心点是否为0可以分为对称量化、非对称量化,详细的量化算法原理请参见量化算法原理)。

|

量化位宽 |

量化根据量化后低比特位宽大小分为常见的INT8、INT16量化:权重量化仅支持INT8量化,数据量化支持INT8和INT16两种量化方式,当前版本仅支持INT8量化。

|

测试数据集 |

数据集的子集,用于最终测试模型的效果。 |

校准 |

训练后量化场景中,做前向推理获取数据量化因子的过程。 |

校准数据集 |

训练后量化场景中,做前向推理使用的数据集。该数据集的分布代表着所有数据集的分布,获取校准集时应该具有代表性,推荐使用测试集的子集作为校准数据集。如果数据集不是模型匹配的数据集或者代表性不够,则根据校准集计算得到的量化因子,在全数据集上表现较差,量化损失大,量化后精度低。 |

量化因子 |

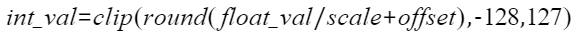

将浮点数量化为整数的参数,包括缩放因子(Scale),偏移量(Offset)。 将浮点数量化为整数(以INT8为例)的公式如下:

|

Scale |

量化因子,浮点数的缩放因子,该参数又分为:

|

Offset |

量化因子,偏移量,该参数又分为:

|