save_model

功能说明

训练后量化接口,将quantize_model接口返回的模型,插入AscendQuant、AscendDequant等算子,然后保存为最终量化模型。

约束说明

传入的模型需要先经过1个batch的推理获得正确的量化因子,如果没有经过推理,直接保存为air,则保存出来的量化因子不正确。

函数原型

save_model(file_name, network, *input_data)

参数说明

参数名 |

输入/返回值 |

含义 |

使用限制 |

|---|---|---|---|

file_name |

输入 |

待生成的air文件的路径和名字。 |

数据类型:string |

network |

输入 |

通过quantize_model接口生成的量化后的模型。 |

数据类型:MindSpore的Cell对象 |

input_data |

输入 |

用户网络输入数据(仅要求数据的format和shape正确,数据本身可以是随机生成的)。 |

数据类型:可以转化为MindSpore Tensor的对象,比如numpy.ndarray对象。 该参数为可变参数,支持用户网络有多个输入的情况。 |

返回值说明

无。

函数输出

可以在昇腾AI处理器做推理的air模型文件。重新执行量化时,该接口输出的上述文件将会被覆盖。

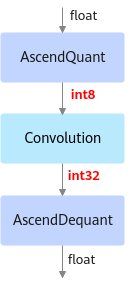

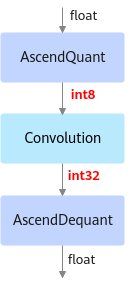

如下图所示,部署模型的AscendQuant层将Float32的输入数据量化为INT8,作为卷积层的输入,权重也是使用INT8数据类型作为计算,在部署模型中的卷积层的计算是基于INT8,INT32数据类型的,输出为INT32数据类型经过AscendDequant层转换成Float32数据类型转输给下一个网络层。

图1 可部署模型

调用示例

1 2 3 |

import amct_mindspore as amct input_data = np.random.uniform(0.0, 1.0, size=[32, 1, 32, 32]).astype(np.float32) amct.save_model('lenet_geir', calibration_network, input_data) |

父主题: 训练后量化接口