接口列表

用户可以基于深度学习框架TensorFlow 2.6.5进行训练或在线推理脚本的开发,TF Adapter提供了适配TensorFlow 2.6.5框架的用户接口。

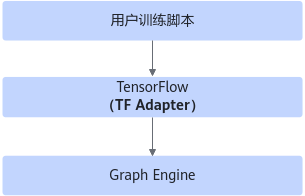

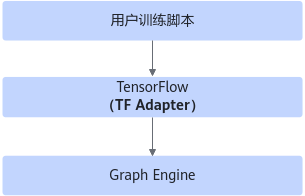

图1 TF Adapter接口

接口路径:{install_path}/python/site-packages/npu_device。

接口名称 |

接口简介 |

|---|---|

用于注册NPU设备,当前必须连续调用as_default设置NPU为默认设备。 |

|

返回NPU设备初始化全局单例配置对象,通过修改该全局单例对象的属性值,可以控制NPU设备初始化时的选项。该接口必须在调用npu.open接口初始化NPU设备前完成设置。 |

|

用于NPU分布式部署场景下,worker间的聚合运算。 |

|

用于NPU分布式部署场景下,worker间的变量同步。 |

|

在更新梯度前,添加npu的allreduce操作对梯度进行聚合,然后再更新梯度。该接口仅在分布式场景下使用。 |

|

用于NPU分布式部署场景下,不同worker上数据集分片及batch大小调整。 |

|

指定哪些算子保持原有精度,如果原始网络模型中的算子精度在昇腾AI处理器上不支持,则系统内部自动采用算子支持的高精度来计算。 |

|

用于设置NPU循环下沉执行时的循环次数。 |

|

NPU提供的LossScaleOptimizer,浮点计算的溢出模式为“饱和模式”的场景下,由于NPU上的溢出运算不保证输出Inf或者NaN,所以此种场景下,使用LossScaleOptimizer的脚本应当替换为该优化器,来屏蔽溢出检测的差异。 |

|

计算高斯误差线性单元 (GELU) 激活函数。将输入Tensor乘以1个P(X <= x),其中P(X) ~ N(0, 1)。 |

|

|

设置针对浮点计算的进程级溢出模式,当前可支持两种溢出模式:饱和模式与INF/NAN模式。

|