save_model

功能说明

训练后量化接口,根据量化因子记录文件record_file以及修改后的模型,插入AscendQuant、AscendDequant等算子,然后保存为可以在Onnx Runtime环境进行精度仿真的fake_quant模型,和可以在昇腾AI处理器做推理的部署模型。

约束说明

- 在网络推理的batch数目达到batch_num后,再调用该接口,否则量化因子不正确,量化结果不正确。

- 该接口只接收quantize_model接口产生的onnx类型模型文件。

- 该接口需要输入量化因子记录文件,量化因子记录文件在quantize_model阶段生成,在模型推理阶段填充有效值。

函数原型

save_model(modified_onnx_file, record_file, save_path)

参数说明

参数名 |

输入/返回值 |

含义 |

使用限制 |

|---|---|---|---|

modified_onnx_file |

输入 |

文件名,存储融合后模型的onnx格式。 |

数据类型:string |

record_file |

输入 |

量化因子记录文件路径及名称。 |

数据类型:string |

save_path |

输入 |

模型存放路径。 该路径需要包含模型名前缀,例如./quantized_model/*model。 |

数据类型:string |

返回值说明

无。

函数输出

- 精度仿真模型文件:ONNX格式的模型文件,模型名中包含fake_quant,可以在ONNX Runtime环境进行精度仿真。

fake_quant模型主要用于验证量化后模型的精度,可以在ONNX Runtime环境下运行。进行前向推理的计算过程中,在fake_quant模型中对卷积层等的输入数据和权重进行了量化反量化的操作,来模拟量化后的计算结果,从而快速验证量化后模型的精度。

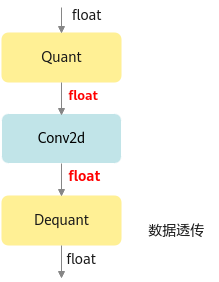

如下图所示,Quant层、Conv2d卷积层和DeQuant层之间的数据都是Float32数据类型的,其中Quant层将数据量化到INT8又反量化为Float32,权重也是量化到INT8又反量化为Float32,实际卷积层的计算是基于Float32数据类型的,该模型用于在ONNX Runtime环境验证量化后模型的精度,不能够用于ATC工具转换成om模型。图1 fake_quant模型

- 部署模型文件:ONNX格式的模型文件,模型名中包含deploy,经过ATC转换工具转换后可部署到在昇腾AI处理器。

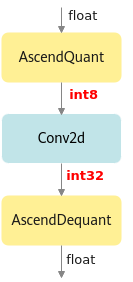

deploy模型由于已经将权重等转换成为了INT8, INT32类型, 因此不能在ONNX Runtime环境上执行推理计算。如下图所示,deploy模型的AscendQuant层将Float32的输入数据量化为INT8,作为卷积层的输入,权重也是使用INT8数据类型作为计算,在deploy模型中的卷积层的计算是基于INT8,INT32数据类型的,输出为INT32数据类型经过AscendDeQuant层转换成Float32数据类型传输给下一个网络层。图2 deploy模型

重新执行量化时,该接口输出的上述文件将会被覆盖。

调用示例

import amct_pytorch as amct

# 进行网络推理,期间完成量化

for i in batch_num:

output = calibration_model(input_batch)

# 插入API,将量化的模型存为onnx文件

amct.save_model(modified_onnx_file="./tmp/modified_model.onnx",

record_file="./tmp/scale_offset_record.txt",

save_path="./results/model")

父主题: 训练后量化