均匀量化

均匀量化是指量化后的数据比较均匀地分布在某个数值空间中,例如INT8量化就是用只有8比特的INT8数据来表示32比特的FP32数据或16比特的FP16数据,将FP32/FP16的卷积运算过程(乘加运算)转换为INT8的卷积运算,加速运算和实现模型压缩;均匀的INT8量化则是量化后数据比较均匀地分布在INT8的数值空间[-128, 127]中。量化示例请参见获取更多样例>resnet101。

如果均匀量化后的模型精度无法满足要求,则需要进行量化感知训练。均匀量化支持量化的层以及约束如下:

量化方式 |

支持的层类型 |

约束 |

备注 |

|---|---|---|---|

均匀量化 |

torch.nn.Linear |

- |

复用层(共用weight和bias参数)不支持量化。 |

torch.nn.Conv2d |

padding_mode为zeros |

||

torch.nn.Conv3d |

dilation_d为1,dilation_h/dilation_w >= 1 |

||

torch.nn.ConvTranspose2d |

padding_mode为zeros |

||

torch.nn.AvgPool2d |

- |

- |

接口调用流程

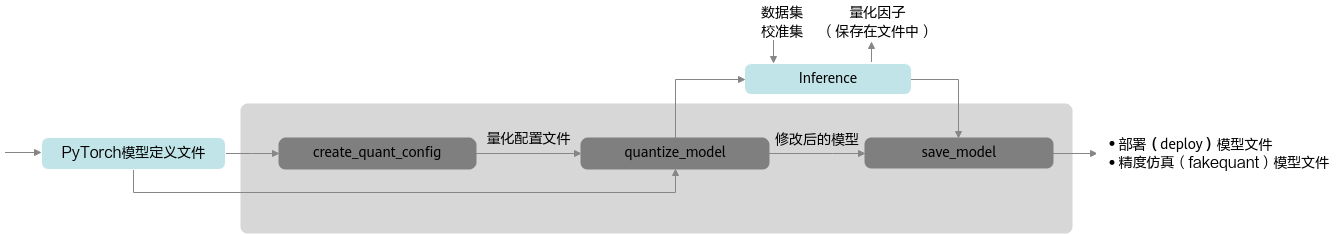

均匀量化接口调用流程如图1所示。

蓝色部分为用户实现,灰色部分为用户调用AMCT提供的API实现,工具使用分为如下场景:

- 用户首先构造PyTorch的原始模型,然后使用create_quant_config生成量化配置文件。

- 根据PyTorch模型和量化配置文件,即可调用quantize_model接口对原始PyTorch模型进行优化,优化后的PyTorch模型中包含了量化算法。

- 使用校准集在PyTorch环境下执行前向推理,产生量化因子,并将量化因子输出到文件中。

- 最后用户可以调用save_model接口保存量化后的模型,包括可在ONNX执行框架ONNX Runtime环境中进行精度仿真的模型文件和可部署在昇腾AI处理器的模型文件。

调用示例

调用示例请参见快速入门。

父主题: 基础量化