Exp

功能说明

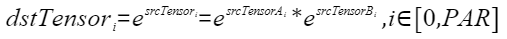

按元素取自然指数,计算公式如下,其中PAR表示矢量计算单元一个迭代能够处理的元素个数。

srcTensorA[i]代表源操作数的整数部分,srcTensorB[i]代表源操作数的小数部分。

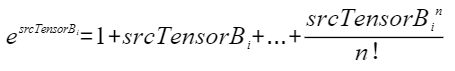

开发者可以选择是否使用泰勒展开公式进行计算,如果设置泰勒展开项数(不为0),表示使用泰勒展开公式进行计算。泰勒展开公式如下:

函数原型

- 通过sharedTmpBuffer入参传入临时空间

1 2

template <typename T, uint8_t taylorExpandLevel, bool isReuseSource = false> __aicore__ inline void Exp(const LocalTensor<T> &dstLocal, const LocalTensor<T> &srcLocal, const LocalTensor<uint8_t> &sharedTmpBuffer, const uint32_t calCount)

- 接口框架申请临时空间

1 2

template <typename T, uint8_t taylorExpandLevel, bool isReuseSource = false> __aicore__ inline void Exp(const LocalTensor<T> &dstLocal, const LocalTensor<T> &srcLocal, const uint32_t calCount)

由于该接口的内部实现中涉及复杂的数学计算,需要额外的临时空间来存储计算过程中的中间变量。临时空间支持开发者通过sharedTmpBuffer入参传入和接口框架申请两种方式。

- 通过sharedTmpBuffer入参传入,使用该tensor作为临时空间进行处理,接口框架不再申请。该方式开发者可以自行管理sharedTmpBuffer内存空间,并在接口调用完成后,复用该部分内存,内存不会反复申请释放,灵活性较高,内存利用率也较高。

- 接口框架申请临时空间,开发者无需申请,但是需要预留临时空间的大小。

通过sharedTmpBuffer传入的情况,开发者需要为tensor申请空间;接口框架申请的方式,开发者需要预留临时空间。临时空间大小BufferSize的获取方式如下:通过GetExpMaxMinTmpSize中提供的接口获取需要预留空间范围的大小。

参数说明

参数名 |

描述 |

|---|---|

T |

操作数的数据类型。 |

taylorExpandLevel |

泰勒展开项数,项数为0表示不使用泰勒公式进行计算。项数太少时,精度会有一定误差。项数越多,精度相对而言更高,但是性能会更差。取值范围为[0, 255],推荐取值为[10, 15] |

isReuseSource |

是否允许修改源操作数,默认值为false。如果开发者允许源操作数被改写,可以使能该参数,使能后能够节省部分内存空间。 设置为true,则本接口内部计算时复用srcTensor的内存空间,节省内存空间;设置为false,则本接口内部计算时不复用srcTensor的内存空间。 对于float数据类型输入支持开启该参数,half数据类型输入不支持开启该参数。 isReuseSource的使用样例请参考更多样例。 |

参数名 |

输入/输出 |

描述 |

|---|---|---|

dstTensor |

输出 |

目的操作数。 类型为LocalTensor,支持的TPosition为VECIN/VECCALC/VECOUT。 Atlas A2训练系列产品/Atlas 800I A2推理产品,支持的数据类型为:half/float |

srcTensor |

输入 |

源操作数。 类型为LocalTensor,支持的TPosition为VECIN/VECCALC/VECOUT。 源操作数的数据类型需要与目的操作数保持一致。 Atlas A2训练系列产品/Atlas 800I A2推理产品,支持的数据类型为:half/float |

sharedTmpBuffer |

输入 |

临时缓存。 类型为LocalTensor,支持的TPosition为VECIN/VECCALC/VECOUT。 用于Exp内部复杂计算时存储中间变量,由开发者提供。 临时空间大小BufferSize的获取方式请参考GetExpMaxMinTmpSize。 Atlas A2训练系列产品/Atlas 800I A2推理产品,支持的数据类型为:uint8_t |

calCount |

输入 |

实际计算元素个数,calCount∈[0, srcTensor.GetSize()]。 |

返回值

无

支持的型号

Atlas A2训练系列产品/Atlas 800I A2推理产品

约束说明

- 不支持源操作数与目的操作数地址重叠。

- 不支持sharedTmpBuffer与源操作数和目的操作数地址重叠。

- 操作数地址偏移对齐要求请参见通用约束。

调用示例

完整的调用样例请参考更多样例。

1 2 3 4 5 6 | AscendC::TPipe pipe; AscendC::TQue<AscendC::TPosition::VECCALC, 1> tmpQue; pipe.InitBuffer(tmpQue, 1, bufferSize); // bufferSize 通过Host侧tiling参数获取 AscendC::LocalTensor<uint8_t> sharedTmpBuffer = tmpQue.AllocTensor<uint8_t>(); // 输入shape信息为1024, 算子输入的数据类型为half, 实际计算个数为512 AscendC::Exp<float, 15, false>(dstLocal, srcLocal, sharedTmpBuffer, 512); |