BlockReduceSum

函数功能

对每个datablock内所有元素求和。源操作数相加采用二叉树方式,两两相加。归约指令的总体介绍请参考归约指令。

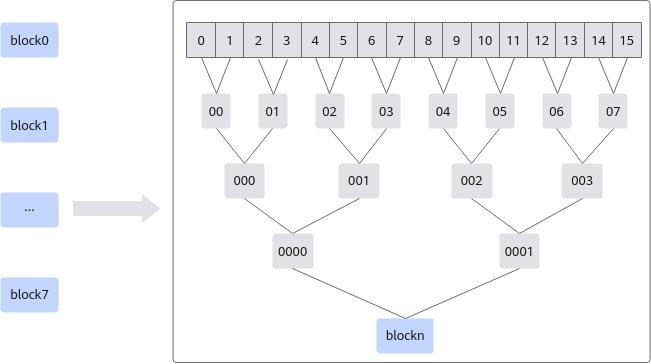

以128个half类型的数据求和为例,每个datablock可以计算16个half类型数据,分成8个block进行计算;每个block内,通过二叉树的方式,两两相加,BlockReduceSum求和示意图如下。

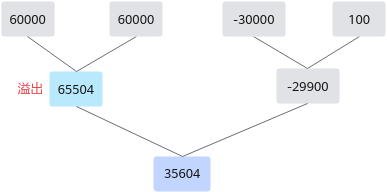

需要注意的是两两相加的计算过程中,计算结果大于65504时结果保存为65504。例如,源操作数为[60000,60000,-30000,100],首先60000+60000溢出,结果为65504,然后计算-30000+100=-29900,最后计算65504-29900=35604,计算示意图如下图所示。

函数原型

- mask逐bit模式:

template <typename T, bool isSetMask = true>

__aicore__ inline void BlockReduceSum (const LocalTensor<T>& dstLocal, const LocalTensor<T>& srcLocal,const int32_t repeat, const uint64_t mask[2], const int32_t dstRepStride, const int32_t srcBlkStride,const int32_t srcRepStride)

- mask连续模式:

template <typename T, bool isSetMask = true>

__aicore__ inline void BlockReduceSum (const LocalTensor<T>& dstLocal, const LocalTensor<T>& srcLocal,const int32_t repeat, const int32_t maskCount, const int32_t dstRepStride, const int32_t srcBlkStride,const int32_t srcRepStride)

参数说明

参数名 |

描述 |

|---|---|

T |

操作数数据类型。 |

isSetMask |

是否在接口内部设置mask。

|

参数名称 |

输入/输出 |

含义 |

|---|---|---|

dstLocal |

输出 |

目的操作数。 类型为LocalTensor,支持的TPosition为VECIN/VECCALC/VECOUT。 Atlas 训练系列产品,支持的数据类型为:half Atlas推理系列产品AI Core,支持的数据类型为:half/float Atlas A2训练系列产品/Atlas 800I A2推理产品,支持的数据类型为:half/float Atlas 200/500 A2推理产品,支持的数据类型为:half/float |

srcLocal |

输入 |

源操作数。 类型为LocalTensor,支持的TPosition为VECIN/VECCALC/VECOUT。 Atlas 训练系列产品,支持的数据类型为:half Atlas推理系列产品AI Core,支持的数据类型为:half/float Atlas A2训练系列产品/Atlas 800I A2推理产品,支持的数据类型为:half/float Atlas 200/500 A2推理产品,支持的数据类型为:half/float |

repeat |

输入 |

迭代次数。取值范围为[0, 255]。 |

mask[2]/ maskCount |

输入 |

mask用于控制每次迭代内参与计算的元素。

|

dstRepStride |

输入 |

目的操作数相邻迭代间的地址步长。以一个repeat归约后的长度为单位。 每个repeat(8个datablock)归约后,得到8个元素,所以输入类型为half类型时,RepStride单位为16Byte;输入类型为float类型时,RepStride单位为32Byte。 注意,此参数值Atlas 训练系列产品不支持配置0。 |

srcBlkStride |

输入 |

单次迭代内datablock的地址步长。详细说明请参考Block stride(同一迭代内不同datablock的地址步长)。 |

srcRepStride |

输入 |

源操作数相邻迭代间的地址步长,即源操作数每次迭代跳过的datablock数目。详细说明请参考Repeat stride(相邻迭代间相同datablock的地址步长)。 |

返回值

无

支持的型号

Atlas 训练系列产品

Atlas推理系列产品AI Core

Atlas A2训练系列产品/Atlas 800I A2推理产品

Atlas 200/500 A2推理产品

注意事项

- 为了节省地址空间,您可以定义一个Tensor,供源操作数与目的操作数同时使用(即地址重叠),需要注意计算后的目的操作数数据不能覆盖未参与计算的源操作数,需要谨慎使用。

- 对于Atlas 200/500 A2推理产品,若配置的mask[2]/maskCount参数后,存在某个datablock里的任何一个元素都不参与计算,则该datablock内所有元素的和会填充为0返回。比如float场景下,当mask配置为32,即只计算前4个datablock,则后四个datablock内的和会返回0。

- 操作数地址偏移对齐要求请参见通用约束。

调用示例

本样例中只展示Compute流程中的部分代码。如果您需要运行样例代码,请将该代码段拷贝并替换样例模板中Compute函数的部分代码即可。

- BlockReduceSum-tensor高维切分计算样例-mask连续模式

uint64_t mask = 256/sizeof(half); int repeat = 1; // repeat = 1, 128 elements one repeat, 128 elements total // srcBlkStride = 1, no gap between blocks in one repeat // dstRepStride = 1, srcRepStride = 8, no gap between repeats BlockReduceSum<half>(dstLocal, srcLocal, repeat, mask, 1, 1, 8);

- BlockReduceSum-tensor高维切分计算样例-mask逐bit模式

uint64_t mask[2] = { UINT64_MAX, UINT64_MAX }; int repeat = 1; // repeat = 1, 128 elements one repeat, 128 elements total // srcBlkStride = 1, no gap between blocks in one repeat // dstRepStride = 1, srcRepStride = 8, no gap between repeats BlockReduceSum<half>(dstLocal, srcLocal, repeat, mask, 1, 1, 8);

输入数据(src_gm): [-7.289, 4.48, -5.898, -6.199, 1.422, -6.168, -3.178, -1.198, 7.789, 6.754, -5.191, -0.6797, 2.883, 2.08, 8.664, -8.539, ..., -7.625, 2.529, 7.855, -2.012, -6.52, -6.652, -8.422, -9.914, -4.355, 1.849, 5.406, 1.483, -6.074, -1.897, 8.625, 1.969] 输出数据(dst_gm): [-10.27, ..., -23.77, 0, ..., 0]