convert_model接口模型适配

如果用户有自己计算得到的量化因子以及TensorFlow原始模型,该模型无法直接使用ATC工具转成适配昇腾AI处理器的离线模型,需要借助昇腾模型压缩工具提供的convert_model接口,将该模型转成CANN量化模型格式,然后才能使用ATC工具,将CANN量化模型转成适配昇腾AI处理器的离线模型。该场景下的适配示例请参见获取更多样例>mobilenetv2。

适配原理

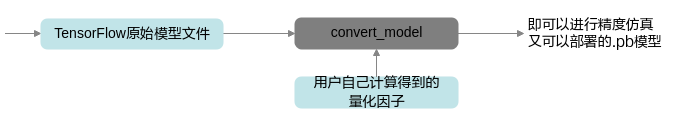

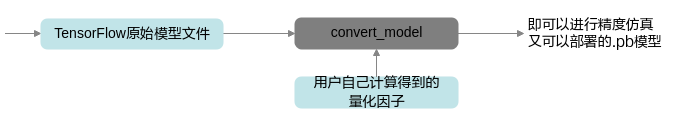

适配原理如图1所示,蓝色部分为用户实现,灰色部分为用户调用昇腾模型压缩工具提供的convert_model接口实现,用户在TensorFlow原始网络推理的代码中导入库,并在特定的位置调用相应API,即可实现模型适配功能。

图1 模型适配原理

调用示例

本示例演示如何使用convert_model接口对原始模型进行适配。

- 如下示例标有“由用户补充处理”的步骤,需要用户根据自己的模型和数据集进行补充处理,示例中仅为示例代码。

- 如果用户需要基于如下代码,对其他模型进行量化,需要准备原始未量化的模型,将用户自己准备的量化因子转换为量化因子记录文件。

- 导入昇腾模型压缩工具包,设置日志级别。

import amct_tensorflow as amct amct.set_logging_level(print_level='info', save_level='info')

- (可选,由用户补充处理)建议使用原始待量化的模型和测试集,在TensorFlow环境下推理,验证环境、推理脚本是否正常。

推荐执行该步骤,以确保原始模型可以完成推理且精度正常;执行该步骤时,可以使用部分测试集,减少运行时间。

user_do_inference(ori_model, test_data)

- 调用昇腾模型压缩工具中的convert_model接口,进行模型适配。该接口内部会将pb格式的模型解析为graph形式,完成图的预处理操作>解析用户传入的量化因子文件>然后根据量化因子和修改后的图结构,插入AscendQuant、AscendDequant等算子,保存为量化模型。

quant_model_path = './result/user_model' record_file = './result/record.txt' amct.convert_model(pb_model=ori_model, outputs=ori_model_outputs, record_file=record_file, save_path=quant_model_path)

- (可选,由用户补充处理)使用量化后模型user_model_quantized.pb和测试集,在TensorFlow环境下推理,测试量化后的仿真模型精度。

使用量化后仿真模型精度与2中的原始精度做对比,可以观察量化对精度的影响。

quant_model = './results/user_model_quantized.pb' user_do_inference(quant_model, test_data)

父主题: 模型适配