算法介绍

Prefix-Tuning通过在输入序列中加入跟任务相关的向量,只训练这部分任务相关的向量,保持预训练模型的参数不变。Prefix-Tuning会在每个attention的key和value向量中插入l个用于更新参数的prefix向量,然后冻结预训练模型的参数, 只更新这些prefix向量的参数,就可以达到近似全参微调的效果。

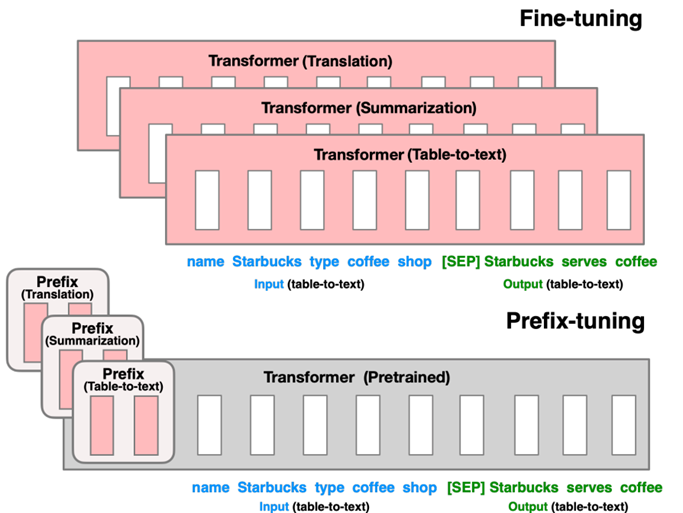

算法原理如图1所示,算法具体实现细节可参考论文Prefix-Tuning: Optimizing Continuous Prompts for Generation。

Prefix算法原理图:对于每个下游任务,添加一份和当前任务相关的prefix向量,冻结预训练模型的其他参数,只训练这些prefix向量。

父主题: Prefix-Tuning算法